Anthropic компаниясы DeepSeek, Moonshot жана MiniMax сыяктуу бир катар кытайлык жасалма интеллектти иштеп чыгуучуларды, өзүнүн Claude деп аталган ИИ мүмкүнчүлүктөрүн колдонуп, моделдерин жакшыртуу үчүн ири масштабдагы дистилляция методун колдонууда деп айыптады.

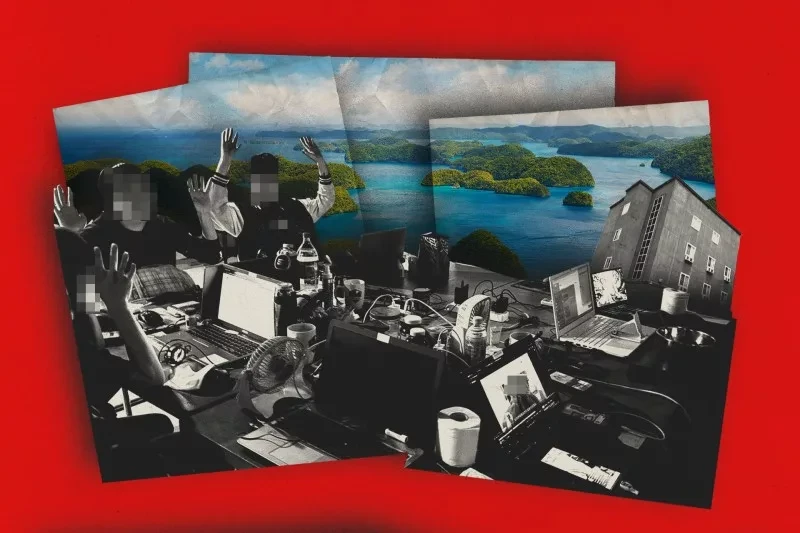

Anthropic компаниясынын маалыматына ылайык, бул процессте 24 000 жасалма аккаунт тартылган, алар аркылуу 16 миллион суроо-талап жасалган. Дистилляция - бул машиналык үйрөнүү техникасы, анда азыраак күчтүү модель, көбүрөөк натыйжалуу моделдин чыгымдарына негизделип үйрөтүлөт.

Бул метод мыйзамдуу болуп эсептелгенине карабастан, Anthropic кытайлык компаниялардын аны колдонушу АКШнын экспорттук чектөөлөрүн жана лицензиялык келишимдерди бузат деп билдирүүдө.

Anthropic өкүлдөрү: «Америка моделдерин мыйзамсыз колдонгон чет элдик лабораториялар, алардын мүмкүнчүлүктөрүн аскердик жана чалгындоо системаларына өткөрүп берүү менен коргоо механизмдерин жок кыла алышат» деп эскертишти.

Мурда DeepSeek компаниясына мындай айыптоолорду башка америкалык компаниялар, анын ичинде OpenAI да койгон, бирок Anthropic конкреттүү далилдерди сунуштады.

Иш жүргүзүү ыкмалары

Anthropic компаниясынын маалыматына ылайык, бул компаниялар миңдеген жасалма аккаунттардан турган тармакты колдонушкан, алар «гидра кластерлерин» түзүп, компаниянын API жана үчүнчү тараптын булуттук платформалары аркылуу трафикти бөлүштүрүшкөн.

Суроо-талаптар жогорку жыштыкта, конкреттүү функцияларга тар багытталган жана маанилүү кайталануучулук менен мүнөздөлгөн, бул моделдердин үйрөнүшүн, жөнөкөй колдонуучулардын аракеттерин эмес, көрсөтүп турат. Мисалы, DeepSeek логикалык чыгаруу жана «коопсуз» саясий сезимтал суроолорду кайра жазуу боюнча 150 000ден ашык суроо-талап жөнөткөн.

Kimi моделин иштеп чыгуучу Moonshot 3,4 миллионго жакын суроо-талаптарды агенттик ой жүгүртүү, программалоо жана компьютердик көрүү боюнча жыйнаган. Өз кезегинде, MiniMax агенттик программалоого багытталган 13 миллионго жакын суроо-талап менен эң ири кампанияны өткөрдү. Claude жаңыртылган версиясы чыккандан кийин, компания жаңы мүмкүнчүлүктөрдү пайдалануу үчүн 24 сааттын ичинде трафиктин жарымына жакынын кайра багыттады.

Реакция чаралары

Бул инциденттерге жооп катары Anthropic ушундай чабуулдардын алдын алуу үчүн коргоону күчөтүү пландарын жарыялады. Компания API трафигинде паттерндерди аныктоого жардам берүүчү классификаторлорду жана жүрүм-турум анализи системаларын киргизүүдө, ошондой эле башка ИИ лабораториялары менен техникалык индикаторлорду бөлүшүүдө жана аккаунттарды текшерүү процессин катуураак кылууда.

Мындан тышкары, мыйзамсыз үйрөнүү үчүн анын чыгымдарын пайдалануу мүмкүнчүлүгүн азайтуу максатында продуктунун жана моделинин деңгээлинде коргоо механизмдери иштелип чыгууда, ошол эле учурда мыйзамдуу колдонуучулардын тажрыйбасын начарлатпастан.