Компания Anthropic обвинила ряд китайских разработчиков искусственного интеллекта, таких как DeepSeek, Moonshot и MiniMax, в том, что они применяют метод крупномасштабной дистилляции для усовершенствования своих моделей, используя возможности её ИИ, известного как Claude.

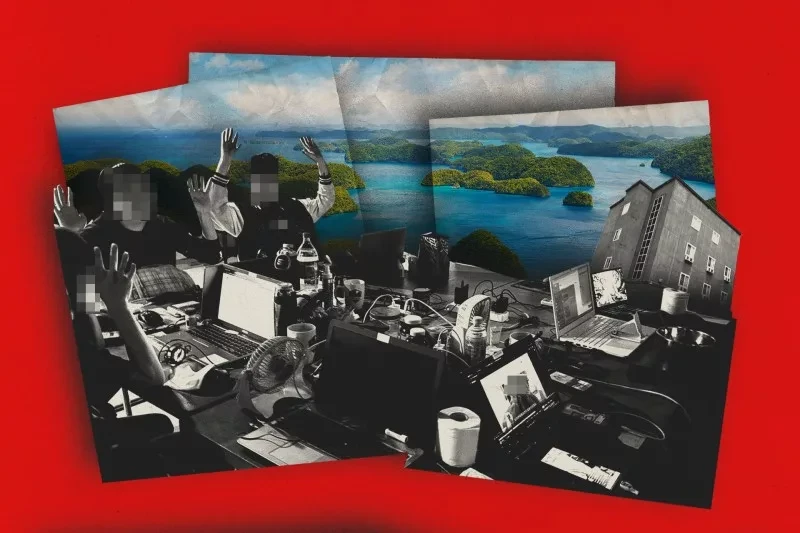

Согласно информации от Anthropic, в этом процессе было задействовано 24 000 фальшивых аккаунтов, через которые осуществлялось 16 миллионов запросов. Дистилляция представляет собой технику машинного обучения, где менее мощная модель обучается на выходах более производительной модели.

Хотя данный метод считается законным, Anthropic утверждает, что его использование китайскими компаниями нарушает экспортные ограничения США и лицензионные соглашения.

Представители Anthropic предупредили: «Иностранные лаборатории, неправомерно использующие американские модели, могут устранять защитные механизмы, передавая их возможности в военные и разведывательные системы».

Ранее такие обвинения в адрес DeepSeek выдвигали и другие американские компании, включая OpenAI, однако Anthropic предоставила более конкретные доказательства.

Способы работы

По информации Anthropic, эти компании использовали сеть из тысяч фальшивых аккаунтов, которые образовывали «кластеры гидры», чтобы распределять трафик через API компании и сторонние облачные платформы.

Запросы отличались высокой частотой, узкой направленностью на специфические функции и значительной повторяемостью, что указывает на обучение моделей, а не на действия обычных пользователей. Например, DeepSeek отправила более 150 000 запросов, направленных на задачи логического вывода и «безопасные» перезаписи политически чувствительных запросов.

Moonshot, разработчик модели Kimi, осуществил более 3,4 миллиона запросов, сосредоточенных на агентском мышлении, программировании и компьютерном зрении. В свою очередь, MiniMax провела крупнейшую кампанию с более чем 13 миллионами запросов, ориентированных на агентское программирование. После выхода обновленной версии Claude, компания перенаправила почти половину трафика в течение 24 часов, чтобы воспользоваться новыми возможностями.

Меры реагирования

В ответ на данные инциденты Anthropic объявила о планах усилить защиту для предотвращения подобных атак. Компания внедряет классификаторы и системы анализа поведения, которые помогут выявить паттерны в трафике API, а также делится техническими индикаторами с другими лабораториями в сфере ИИ и ужесточает процесс верификации аккаунтов.

Кроме того, разрабатываются защитные механизмы как на уровне продукта, так и модели, чтобы снизить возможность использования её выводов в незаконном обучении, при этом не ухудшая опыт законных пользователей.