По данным нового исследования, проведенного ЮНИСЕФ в сотрудничестве с международной организацией ECPAT и Интерполом, более 1,2 миллиона детей в 11 странах сообщили о том, что их изображения были использованы для создания откровенных подделок сексуального характера в прошлом году. В некоторых регионах пострадал каждый 25-й ребенок, что соответствует одному ученику в обычном классе.

Дети осознают риски, связанные с использованием ИИ для создания поддельных сексуальных изображений. В тех странах, где проводилось исследование, до двух третей опрошенных детей выразили свою тревогу по поводу возможности использования ИИ для создания фальшивых сексуальных материалов. Уровень обеспокоенности значительно варьируется от страны к стране, что подчеркивает необходимость повышения осведомленности и внедрения мер по профилактике и защите.

Следует уточнить, что сексуализированные изображения детей, созданные с помощью ИИ, попадают под категорию материалов, связанных с сексуальным насилием над детьми (CSAM). Злоупотребление дипфейками является серьезной проблемой, которая наносит реальный вред.

Использование изображений или личностей детей делает их непосредственными жертвами. Даже если нет возможности идентифицировать жертву, материалы, созданные с помощью ИИ, способствуют нормализации сексуальной эксплуатации детей, создают спрос на насильственный контент и затрудняют работу правоохранительных органов в выявлении и защите нуждающихся в помощи детей.

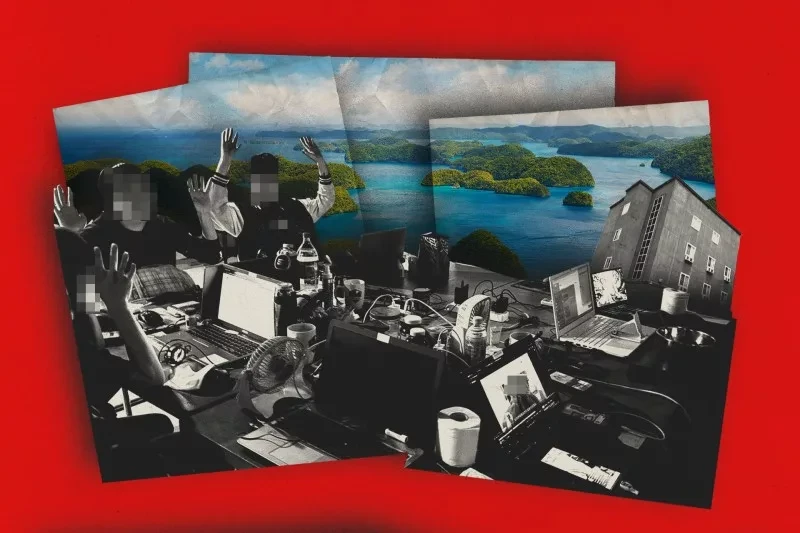

ЮНИСЕФ положительно оценивает усилия разработчиков ИИ, которые стремятся внедрять меры безопасности и защиты для предотвращения неправомерного использования своих технологий. Однако многие модели ИИ продолжают разрабатываться без соответствующих гарантий. Риски усугубляются, когда инструменты генеративного ИИ интегрируются в социальные сети, что способствует быстрому распространению обработанных изображений.

Организация призывает к следующим действиям для борьбы с растущей угрозой, связанной с материалами о сексуальном насилии над детьми, созданными с применением ИИ:

- Все правительства должны расширить определение материалов о сексуальном насилии над детьми (CSAM), включая контент, созданный ИИ, и криминализировать его создание, хранение и распространение.

- Разработчики ИИ должны внедрять безопасные подходы на этапе разработки и надежные меры защиты для предотвращения неправомерного использования своих моделей.

- Цифровые компании должны разработать механизмы для предотвращения распространения материалов сексуального характера, созданных с помощью ИИ, и улучшить модерацию контента, чтобы такие материалы могли быть удалены немедленно, а не через дни после обращения жертвы.

Вред от злоупотребления дипфейками реальный и требует незамедлительных мер. Дети не могут ждать, пока законы вступят в силу.