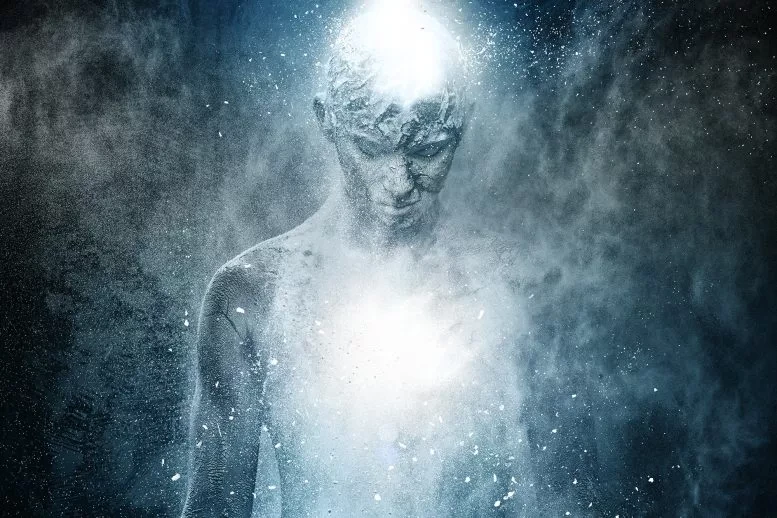

Обучение генеративного ИИ происходит на основе произведений искусства и литературы, созданных на протяжении веков. Однако возникает вопрос: что произойдет, когда искусственный интеллект начнет учиться на своих собственных результатах? Недавнее исследование предлагает некоторые ответы на этот вопрос.

В январе 2026 года команда исследователей в области искусственного интеллекта, включая Аренда Хинтце, Фриду Прошингер Острём и Джори Шоссау, опубликовала результаты своего эксперимента, в ходе которого изучали, как генеративные системы ведут себя, когда им предоставляется возможность действовать самостоятельно — генерировать и интерпретировать свои результаты без человеческого вмешательства.

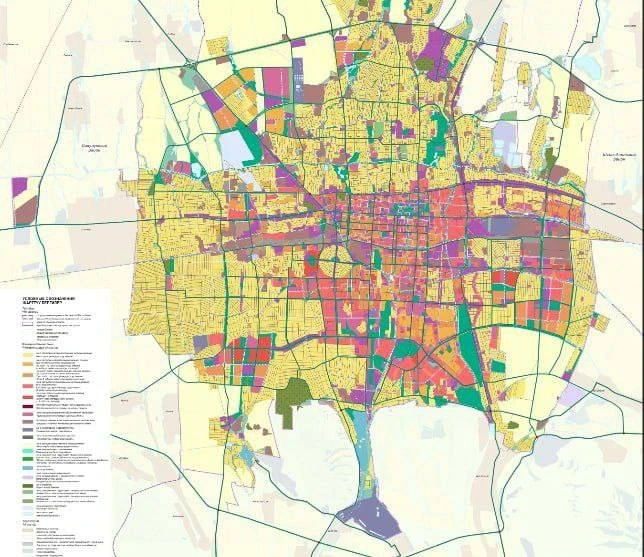

В рамках исследования была объединена система, преобразующая текст в изображения, и система, преобразующая изображения в текст. Эти системы работали по циклу «изображение — описание — изображение — описание», и, несмотря на разнообразие начальных запросов, они быстро пришли к узкому набору распространенных визуальных тем, таких как городские пейзажи, величественные здания и пасторальные ландшафты. Удивительно, но система вскоре «забыла» исходный запрос, в результате чего полученные изображения выглядели эстетично, но были лишены смысла.

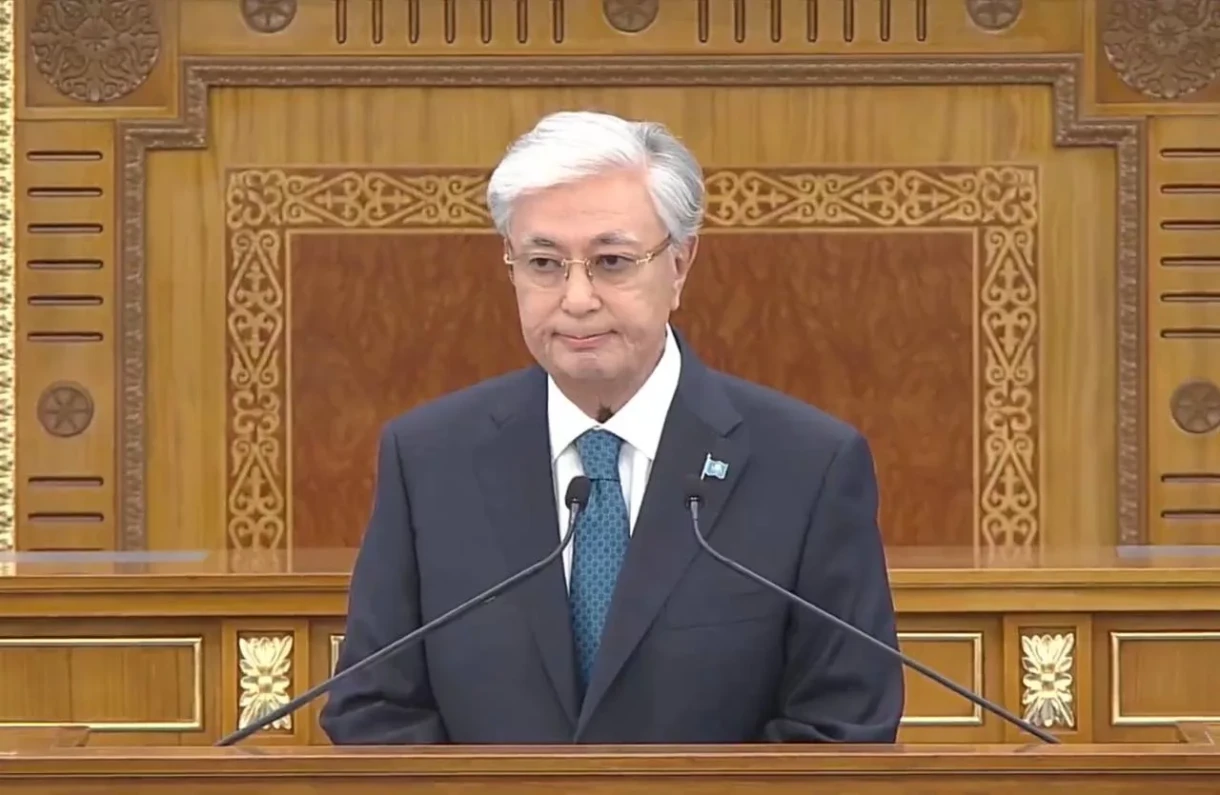

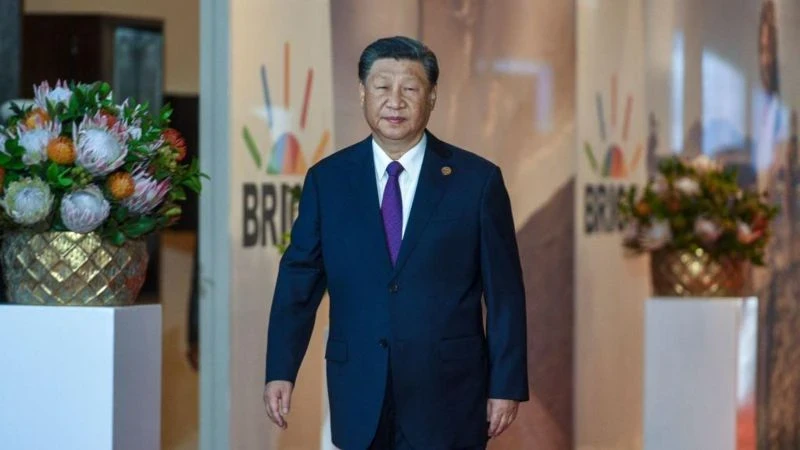

Эксперимент начинался с описания, например: «Премьер-министр анализирует стратегические документы, чтобы убедить общественность в необходимости хрупкого мирного соглашения». Затем ИИ добавлял к изображению подпись, которая использовалась как подсказка для создания следующего изображения. В итоге, исследователи получили довольно скучное изображение формального интерьера — без людей и динамики, без ощущения времени и места.

Эти результаты показывают, что генеративные системы ИИ, работая автономно, склонны к гомогенизации. Более того, можно предположить, что они уже функционируют именно так по умолчанию.

Стандартное как знакомое

Хотя данный эксперимент может показаться несущественным, большинство пользователей не требуют от ИИ бесконечно генерировать и описывать свои изображения. Упрощение до стандартных изображений произошло без переобучения: новые данные не добавлялись, и проблема возникла только из-за повторного использования. Однако эксперимент можно рассматривать как инструмент диагностики, демонстрирующий, как работают генеративные системы без вмешательства.

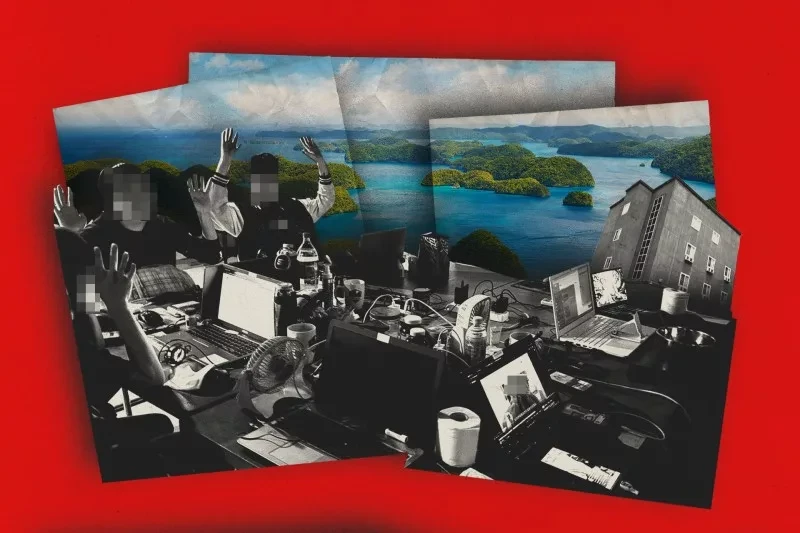

Эти результаты могут оказать значительное влияние на современную культуру, поскольку такие системы все активнее влияют на создание контента. Изображения превращаются в текст, текст в изображения, а контент фильтруется и перерабатывается при переходе от слов к изображениям и видео. В настоящее время многие статьи в интернете пишутся ИИ, и даже когда участвуют люди, они часто выбирают варианты, созданные ИИ, а не начинают с чистого листа.

Показатели этого исследования указывают на то, что по умолчанию эти системы стремятся к сокращению смысла до привычного и легко воспроизводимого.

Стагнация или ускорение культуры?

Некоторые критики утверждают, что генеративный ИИ может привести к культурной стагнации, заполнив интернет синтетическим контентом, на котором будут обучаться будущие системы ИИ. Согласно этому мнению, рекурсивный цикл со временем приведет к уменьшению разнообразия и инноваций.

Сторонники новых технологий, однако, утверждают, что подобные опасения о культурном упадке возникают с каждой новой технологией. Они уверены, что конечные решения в творческих вопросах всегда останутся за людьми.

В этих дискуссиях не хватает эмпирических данных, которые могли бы продемонстрировать, где именно начинается гомогенизация.

И хотя новое исследование не сосредотачивается на переобучении с использованием данных, созданных ИИ, оно выявляет более глубокую проблему: гомогенизация происходит еще до того, как начинается переобучение. Контент, который создается генеративными системами ИИ при автономном и многократном использовании, уже является сжатым и универсальным. Это меняет представление о стагнации. Риск заключается не только в том, что будущие модели могут обучаться на контенте, созданном ИИ, но и в том, что культура, опосредованная ИИ, уже отфильтрована так, что предпочтение отдается знакомому и общепринятому.

Не моральная паника

Скептики правы в одном: культура всегда адаптировалась к новым технологиям. Например, фотография не уничтожила живопись, а кино не вытеснило театр. Цифровые инструменты открыли новые возможности для самовыражения. Однако более ранние технологии не заставляли культуру бесконечно трансформироваться в различных средах на глобальном уровне. Они не обобщали, не генерировали и не ранжировали культурные продукты — будь то статьи, песни, мемы, научные работы или посты в социальных сетях — миллионы раз в день, основываясь на одних и тех же представлениях о том, что является «обычным».

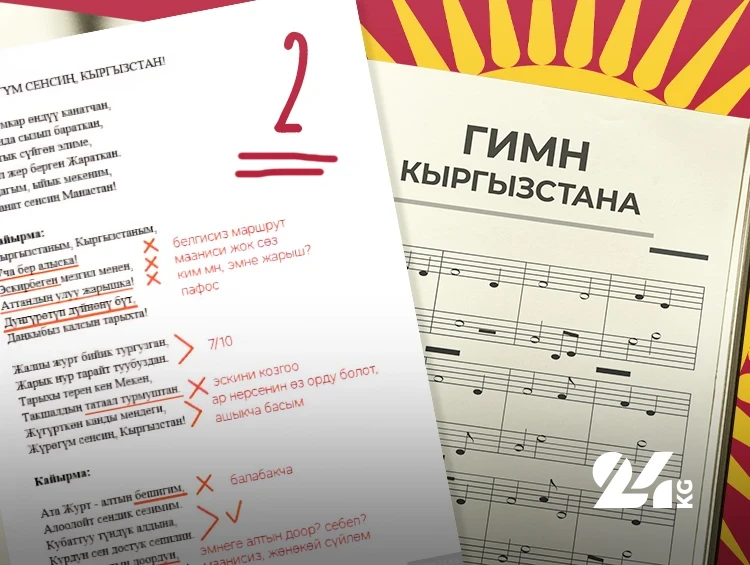

Эксперимент показал, что при многократном повторении цикла разнообразие сокращается не из-за злого умысла, а потому, что лишь определенные виды смысла сохраняются при преобразовании текста в изображение и обратно. Это не означает, что культурный застой неизбежен. Человеческое творчество обладает стойкостью, и различные институты, субкультуры и художники всегда находили способы противостоять гомогенизации. Однако риск застоя реален, если оставить генеративные системы в их нынешнем состоянии.

Это исследование также развенчивает миф о креативности ИИ: создание множества вариаций не равно созданию инноваций. Система может генерировать миллионы изображений, но лишь исследует небольшой фрагмент культурного пространства.

Для появления чего-то нового необходимо разрабатывать ИИ-системы, которые будут стремиться к отклонениям от общепринятого в культуре.

Ошибка перехода

При каждом написании подписи к изображению некоторые детали теряются. Это также происходит и при создании изображения из текста, независимо от того, выполняет задачу человек или машина. В этом смысле произошедшая конвергенция — это не уникальная проблема ИИ, а отражение более глубокого свойства — перехода из одной среды в другую. Когда смысл многократно проходит через два различных формата, сохраняются только наиболее стабильные элементы.

Авторы исследования показывают, что смысл обрабатывается внутри генеративных систем с тенденцией к обобщению, выделяя то, что сохраняется при многократном преобразовании текста в изображения и обратно.

Вывод неутешителен: даже с участием человека — будь то написание подсказок, выбор или доработка результатов — эти системы все равно отсекают одни детали и усиливают другие, ориентируясь на «средние» показатели.

Если генеративный ИИ должен обогащать культуру, а не нивелировать её, системы необходимо организовать так, чтобы предотвратить снижение качества контента до статистически усредненных результатов. Нужно поощрять отклонения и поддерживать менее распространенные формы самовыражения.

Исследование ясно демонстрирует, что без таких мер генеративный ИИ будет продолжать создавать посредственный и неинтересный контент. Культурная стагнация — это уже не просто предположение; она имеет место.

Источник