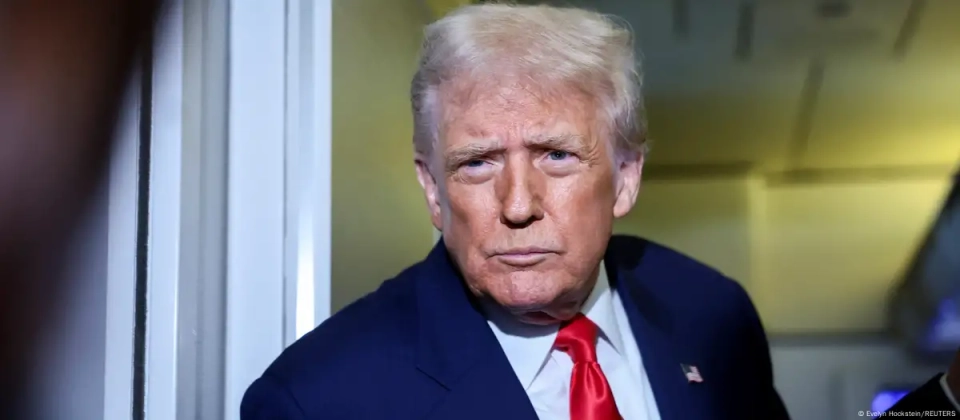

Дональд Трамп в своем сообщении на Truth Social заявил, что у правительственных учреждений, включая Пентагон, есть шесть месяцев для завершения использования продукции Anthropic. Министр обороны Пит Хегсет позже уточнил на платформе X, что Anthropic будет считаться «риском в цепочке поставок». Это обозначение обычно применяется к компаниям, воспринимаемым как продолжение иностранных противников.

Этот шаг завершают недельные переговоры между правительством и Anthropic, которые могут существенно повлиять на будущее применения технологий искусственного интеллекта. Конфликт между компанией и Пентагоном возник из-за ограничений, накладываемых на популярную модель AI от Anthropic.

В пятницу Anthropic выпустила заявление, в котором указала, что считает решение Трампа юридически необоснованным и опасным прецедентом для американских компаний, работающих с правительством. Компания подчеркнула, что ни угроза, ни санкции со стороны Министерства обороны не изменят их позицию относительно использования технологий в массовом наблюдении или полностью автономном оружии, и они готовы оспорить любое решение о признании риска для цепочки поставок в суде.

Пентагон, использующий систему AI Claude от Anthropic в своих секретных сетях, хочет применять её для всех легитимных целей. Однако Anthropic установила две «красные линии»: Claude не должна использоваться в автономном оружии и для массового наблюдения за гражданами США.

Пентагон утверждает, что ему нужна свобода использования лицензированных технологий, и не заинтересован в ограничениях со стороны компании. Конфликт достиг своего апогея во вторник на важной встрече в Пентагоне между Хегсетом и генеральным директором Anthropic Дарио Амодеи. Хотя встреча проходила в доброжелательной атмосфере, комментарии Трампа в пятницу указывают на изменение в ситуации.

В четверг Anthropic подтвердила, что не собирается идти на уступки требованиям Пентагона, заявив, что «угрозы не изменяют нашей позиции: мы не можем с чистой совестью удовлетворить их просьбу».

Заместитель министра Пентагона по исследованиям и разработкам Эмиль Михаэль сообщил в интервью Bloomberg, что они находились «на завершающей стадии» сделки с Anthropic, соответствующей их требованиям, когда компания сделала свое заявление в четверг.

Представитель Пентагона Шон Парнелл отметил, что их просьба — это простая и здравомыслящая мера, которая предотвратит угрозу критически важным военным операциям и рискам для военнослужащих. «Мы не позволим ни одной компании диктовать условия оперативных решений», — добавил он.

В пятницу Трамп обвинил Anthropic в «катастрофической ошибке» и попытке диктовать, как должны действовать военные. Вскоре после этого Управление общих служб объявило о намерении удалить Anthropic с платформы USAi.gov, предназначенной для тестирования инструментов искусственного интеллекта.

Хегсет подтвердил, что «никакому подрядчику, поставщику или партнеру, работающему с вооруженными силами США», не будет разрешено взаимодействовать с компанией Anthropic.

На неделе представители индустрии искусственного интеллекта в значительной степени поддержали Anthropic, а генеральный директор OpenAI Сэм Альтман заявил, что разделяет опасения компании относительно сотрудничества с Пентагоном.

Ответы Anthropic и OpenAI на запрос CNN о комментариях не поступили.

Какую работу компания Anthropic выполняла совместно с Пентагоном?

Модель искусственного интеллекта Claude от Anthropic стала первой, которая была внедрена в секретные военные сети. Прошлым летом компания подписала контракт с Пентагоном на сумму до 200 миллионов долларов, в то время как другие крупные разработчики ИИ, такие как OpenAI, работали только с несекретными сетями.

В контракте Anthropic была предусмотрена «политика допустимого использования», запрещающая использовать систему Claude для массового наблюдения и автономного оружия.

«Этот конфликт возник в неподходящий момент, поскольку, по моим данным, пользователи в Министерстве обороны довольны Anthropic и её продуктом Claude, и ограничения на использование, по крайней мере, никогда не применялись», — заявил Грегори Аллен, старший советник Центра стратегических и международных исследований, в эфире Bloomberg Radio.

Пентагон, однако, не хочет быть ограничен условиями какой-либо компании. Представитель ведомства подчеркнул, что «тактические операции не могут управляться на основе исключений», и «ответственность за соблюдение закона лежит на Пентагоне как конечном пользователе».

Пентагон стремится избежать ситуации, угрожающей национальной безопасности, когда ему необходимо получать разрешение от компании и нарушать свои собственные правила.

Разрыв связей с Anthropic может стать проблемой для Пентагона, поскольку потребуются замены для всех внутренних систем, использующих Claude. Хотя представитель Пентагона упомянул, что система AI Grok Илона Маска «может использоваться в секретных условиях», она не считается такой же мощной, как Claude.

Как это повлияет на бизнес компании Anthropic?

Хотя утрата контракта на 200 миллионов долларов не представляет экзистенциальной угрозы для Anthropic, чья рыночная капитализация оценивается примерно в 380 миллиардов долларов, более значительный риск связан с возможностью, что любая компания, работающая с американскими военными, должна будет доказать отсутствие связей с Anthropic.

Успех Anthropic во многом зависит от контрактов с крупными корпорациями, многие из которых могут иметь связи с Пентагоном.

«Это означает, что значительная часть клиентской базы Anthropic может исчезнуть, если у них есть государственные контракты или они захотят заключить такие контракты в будущем», — пояснил Адам Коннор, вице-президент по технологической политике в Центре американского прогресса, аналитическом центре в Вашингтоне.

Дженсен Хуанг, генеральный директор компании Nvidia, крупнейшего производителя чипов для AI, выразил надежду на возможность достижения соглашения между Пентагоном и Anthropic, но добавил, что «это не конец света», так как есть и другие компании, занимающиеся AI, с которыми Пентагон может сотрудничать.

Пентагон также рассматривает возможность принуждения Anthropic к сотрудничеству в рамках Закона о государственных закупках 1950 года, который предоставляет президенту значительные полномочия по контролю над промышленностью. Однако неясно, как Пентагон сможет одновременно применить этот закон и признать Anthropic угрозой для цепочки поставок.

Трамп не уточнил, будет ли применяться соглашение об отсрочке судебного преследования.

«Anthropic — не единственная компания под угрозой», — отметил Коннор. «Действия Пентагона посылают сигнал другим компаниям, которые хотят заработать, продавая свои услуги правительству».

«Это также подразумевает, что другие компании, занимающиеся AI, с которыми ведутся переговоры, должны быть осторожны в отношении ограничения использования своих технологий», — добавил он.

Если бы Пентагон просто не был доволен условиями Anthropic, он мог бы расторгнуть контракт и заключить соглашение с другой компанией, заявил Алан Розенштейн, профессор права в Университете Миннесоты.

«Правительство действительно хочет продолжать использовать технологии Anthropic, и оно использует все возможные рычаги влияния», — добавил он. «Это очень мощный рычаг влияния».

Неясно, как военные заменят системы, разработанные Anthropic, и планирует ли администрация предпринимать дальнейшие шаги в этом направлении.

«Сравните отечественного лидера в области AI с текущей ситуацией, когда Белый дом говорит о гонке AI с Китаем, что аналогично космической гонке времен холодной войны с Советским Союзом. Вы не захотите потерять один из жемчужин своей отрасли из-за таких разногласий», — заключил Аллен в эфире Bloomberg.

«Существует более разумный способ разрешить данный конфликт, чем придерживаться жесткой позиции, занятой администрацией».