Спрашиваешь совет о здоровье у чат-бота? После недавнего запуска сервиса ChatGPT Health от OpenAI стоит учесть несколько важных факторов

С запуском ChatGPT Health от OpenAI возникает ряд важных аспектов, которые следует учитывать, прежде чем обращаться к ИИ-чатботам за медицинскими рекомендациями.

С учетом того, что миллионы пользователей уже ищут совета у чат-ботов, было лишь вопросом времени, когда технологические компании начнут разрабатывать специализированные решения для ответов на вопросы здоровья.

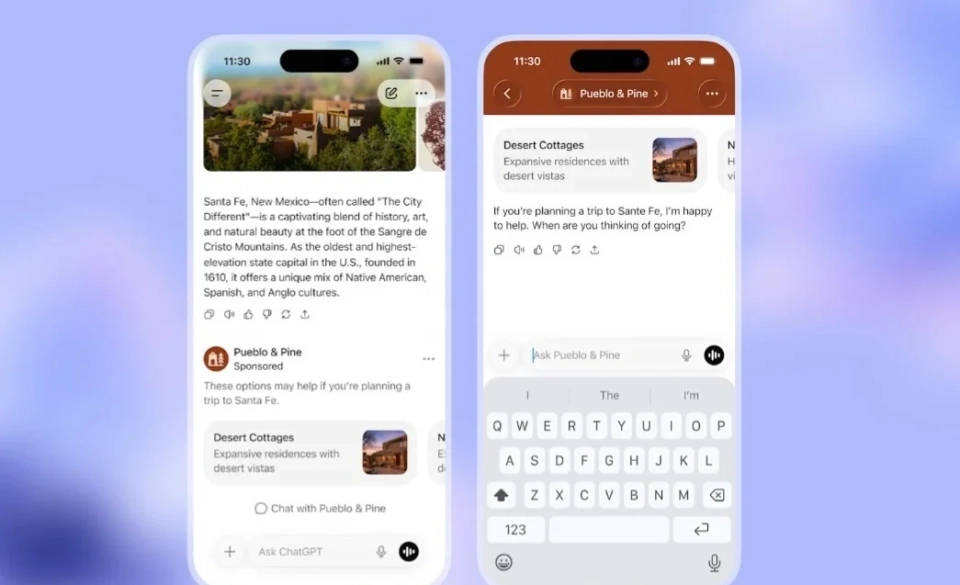

В январе OpenAI представила обновленную версию своего чат-бота — ChatGPT Health, который, по заявлениям компании, способен анализировать медицинские записи и данные с носимых устройств для предоставления ответов по медицинским вопросам.

В настоящее время доступ к программе осуществляется по предварительной записи. Конкурирующая компания Anthropic также предлагает аналогичные функции для пользователей своего чат-бота Claude.

Обе компании акцентируют внимание на том, что их разработки — это большие языковые модели, которые не могут заменить квалифицированную медицинскую помощь и не должны использоваться для постановки диагнозов. Вместо этого, чат-боты способны обобщать сложные результаты анализов, помогать подготовиться к приему у врача и выявлять важные изменения в состоянии здоровья на основе медицинских записей.

Тем не менее, насколько безопасно и точно эти технологии способны анализировать данные о здоровье? Действительно ли стоит на них полагаться?

Вот несколько моментов, которые стоит учесть перед тем, как обсуждать свое здоровье с ИИ:

Индивидуализированная информация от чат-ботов может превзойти Google

Некоторые специалисты, работавшие с ChatGPT Health и подобными платформами, считают их значительным шагом вперед в области медицинской информации.

Несмотря на то что ИИ-системы не идеальны и иногда могут предоставлять неверные советы (источник на английском языке), они часто предлагают более персонализированные и специфичные ответы, чем результаты поиска в Google.

«Часто у пациента нет никакой альтернативы, или он действует наугад, — отмечает доктор Роберт Вахтер, специалист по медицинским технологиям из Калифорнийского университета в Сан-Франциско. — Поэтому, если подходить к использованию этих инструментов ответственно, можно извлечь из них реальную пользу».

В странах, таких как Великобритания и США, где ожидание приема у врача может длиться неделями, а в неотложных отделениях пациенты могут ждать часами, чат-боты помогают избежать лишней паники и сэкономить время.

Кроме того, они могут указать на необходимость немедленного обращения к врачу, если симптомы представляют опасность.

Одним из достоинств новых чат-ботов является их способность учитывать медицинскую историю пользователей, включая текущие лекарства, возраст и врачебные записи.

Даже если вы не делитесь своими медицинскими данными, Вахтер и другие эксперты советуют предоставлять как можно больше деталей, чтобы ответы были более точными.

Не обращайтесь к ИИ при тревожных симптомах

Вахтер и его коллеги подчеркивают, что в некоторых случаях необходимо сразу обратиться за медицинской помощью, а не полагаться на чат-бота. Симптомы, такие как одышка, боль в груди или сильная головная боль, могут указывать на серьезные проблемы со здоровьем.

Даже в менее критичных ситуациях и пациенты, и врачи должны относиться к ИИ-программам с осторожностью, отмечает доктор Ллойд Майнор из Стэнфордского университета.

«Когда речь идет о серьезных медицинских решениях или даже о менее значительных вопросах здоровья, нельзя полагаться исключительно на информацию, предоставляемую большими языковыми моделями», — добавляет Майнор, декан медицинской школы Стэнфорда.

Даже в случае распространенных состояний, таких как синдром поликистозных яичников, лучше обратиться к настоящему врачу — так как заболевание может проявляться по-разному у разных людей, что влияет на выбор лечения.

Учитывайте конфиденциальность при загрузке данных о здоровье

Многие преимущества, предлагаемые ИИ-ботами, основываются на том, что пользователи делятся личной медицинской информацией. Важно помнить, что все данные, передаваемые компании, разрабатывающей ИИ, не защищены федеральным законом о конфиденциальности в США, который регулирует обращение с чувствительными медицинскими данными.

Закон, известный как HIPAA, накладывает штрафы и уголовные наказания для врачей, больниц и других медицинских учреждений за разглашение медицинской информации. Однако он не распространяется на компании, создающие чат-боты.

«Когда человек передает свою медицинскую карту модели, это совершенно не то же самое, что передать ее врачу, — объясняет Майнор. — Потребители должны понимать, что стандарты конфиденциальности в этих случаях совершенно разные».

В OpenAI и Anthropic утверждают, что данные о здоровье пользователей хранятся отдельно и защищены дополнительными мерами. Компании не используют медицинскую информацию для обучения своих моделей. Пользователи должны отдельно согласиться на передачу таких данных и могут в любой момент отказаться от этого.

Хотя интерес к ИИ велик, независимые исследования таких технологий все еще находятся на начальной стадии. Первые результаты показывают, что программы, подобные ChatGPT, успешно справляются со сложными медицинскими экзаменами, но часто ошибаются в общении с живыми людьми.

Недавно проведенное исследование Оксфордского университета с участием 1300 человек показало, что те, кто использовал ИИ-чат-ботов для поиска информации о гипотетических заболеваниях, не принимали более обоснованных решений, чем те, кто полагался на традиционный онлайн-поиск или собственные суждения.

Когда чат-ботам предлагали медицинские сценарии в письменной форме, они правильно определяли основное заболевание в 95% случаев.

«Это не было проблемой, — комментирует ведущий автор исследования Адам Махди из Оксфордского университета. — Проблемы возникали на этапе взаимодействия с реальными людьми».

Махди и его команда выявили несколько трудностей в коммуникации. Люди часто не предоставляли чат-ботам достаточной информации для точной оценки проблемы, а сами системы нередко давали смесь правильных и неправильных ответов, что затрудняло пользователям их различение.

Исследование, проведенное в 2024 году, не охватывало последние версии чат-ботов, включая ChatGPT Health.

Второе мнение от ИИ может оказаться полезным

Способность чат-ботов задавать уточняющие вопросы и извлекать ключевую информацию у пользователей — это область, где, по мнению Вахтера, еще есть много возможностей для улучшения.

«Я считаю, что они станут действительно эффективными, когда их общение с пациентами будет более «врачебным», а диалог будет напоминать настоящий разговор», — считает Вахтер.

Тем временем, один из способов повысить уверенность в полученной информации — проконсультироваться с несколькими чат-ботами, как пациенты иногда получают второе мнение от другого врача.

«Иногда я ввожу одни и те же данные в ChatGPT и Gemini, — делится Вахтер, имея в виду ИИ-инструмент Google. — И когда их ответы совпадают, я чувствую себя более уверенно, что это правильный ответ».

Запись Спрашиваешь совет о здоровье у чат-бота? Обратите внимание на несколько важных факторов после запуска ChatGPT Health от OpenAI была опубликована на K-News.

Читайте также:

Кабмин обновил реестры Минстроя: вводятся платные услуги по реестру строящихся объектов и подтверждению завершения работ

- 25 декабря 2025 года Кабинет министров издал постановление №832, в рамках которого были внесены...

Администрация Трампа приказала военным подрядчикам и федеральным агентствам прекратить сотрудничество с компанией Anthropic

Дональд Трамп в своем сообщении на Truth Social заявил, что у правительственных учреждений,...

В Кыргызстане хотят запустить программу климатического образования до 2030 года

Министерство науки, высшего образования и инноваций Кыргызской Республики инициировало обсуждение...

Водительская реформа, слова Жапыкеева, визы, цены, ГИК. Каким был январь 2026 года?

Январь 2026 года стал для жителей Кыргызстана особенно продолжительным. Кажется, что прошли не дни,...

Anthropic обвинила китайские компании в краже данных Claude

Компания Anthropic обвинила ряд китайских разработчиков искусственного интеллекта, таких как...

Проблемы диагностики дисплазии тазобедренного сустава в Кыргызстане. Архивное интервью с Касымбеком Тазабековым

В Кыргызстане ортопедические заболевания остаются одной из ключевых медицинских проблем. По словам...

ИИ может изменить ваши политические взгляды

Недавние исследования показали, что краткий разговор с обученным чат-ботом был в четыре раза более...

«Цифровой контроль от импорта до пациента». На каком этапе сейчас система прослеживаемости лекарственных средств в Кыргызстане?

В течение последних нескольких лет в Кыргызстане активно реализуется Электронная база данных...

Кабмин разрешил таврение скота при чипировании: знак «i» будут наносить жидким азотом

- 20 февраля 2026 года было принято новое постановление №124, вносящее изменения в документ «О...

У ИИ-ботов появилась собственная соцсеть: что нужно знать о Moltbook

Закрытая для людей: в новой социальной сети для ИИ-ботов они могут взаимодействовать, проводить...

Токаев: Казахстан вступил в новый этап модернизации

Президент Казахстана рассказал о реформах в республике Касым-Жомарт Токаев, президент Казахстана,...

Aeon: как завоевание чужих территорий стало считаться недопустимым

Автор: Кэри Гёттлих В современном мире существует всё меньше вещей, вызывающих согласие среди...

Совет мира Трампа проламывает стену БРИКС

Критика Совета мира не может скрыть амбициозный замысел этой инициативы. Несмотря на то, что успех...

Игра с мирами: новые технологии отменят клиповое внимание

Как соучредительница Chima, исследовательской лаборатории в области прикладного ИИ, я активно...

Человечество не готово. Бесконтрольное развитие ИИ несет катастрофические риски

Фото из интернета. Дарио Амодеи, генеральный директор и сооснователь компании Anthropic В одном из...

Небоевые и непризнанные: самоубийства в украинской армии, о которых молчат

Это перевод статьи с Украинской службы Би-би-си. Оригинал доступен Текст содержит чувствительные...

TikTok собирает данные пользователей, даже если они не используют приложение. «Би-би-си» рассказал, как защитить свою конфиденциальность

TikTok активно собирает информацию о своих пользователях, что является обычной практикой для...

Пользователи массово удаляют ChatGPT: в чем причина

Материал подготовлен K-News. Копирование или частичное использование возможно только с разрешения...

Программа культурного обмена J-1 в США превратилась в схему наживы и эксплуатации иностранных стажеров, - The New York Times

Еще одна схема включала трудоустройство близких родственников генерального директора, что принесло...

Монголия присоединилась к Форуму по геостратегическому взаимодействию в ресурсной сфере (FORGE)

Согласно информации, представленным MiddleAsianNews, Соединенные Штаты, совместно с союзниками и...

Минпросвещения предлагает дополнить работу онлайн-школы «Тунгуч» тремя новыми направлениями

Правительство Кыргызстана получит на общественное обсуждение проект постановления о пилотном...

Казино только для иностранцев: Казахстан пытается повторить сингапурский трюк

Казахстан стремится повторить удачный опыт Сингапура в создании игорных зон, однако рискует...

Чат-боты ИИ искажают реальность пользователей — исследование

Исследование аналитиков компании Anthropic показало, что в редких, но значимых случаях...

В Давосе главы Microsoft, Anthropic и Google DeepMind изложили свои взгляды на будущее ИИ и выразили опасения по поводу его рисков

На Всемирном экономическом форуме в Давосе 2026 года ключевые фигуры из Microsoft, Anthropic и...

Российские и украинские производители дронов покупают комплектующие у одних и тех же китайских компаний

Как сообщает The Financial Times, российские и украинские производители беспилотников используют...

Клетки, люди и ИИ мыслят одинаково — группа ученых обнаружила общий алгоритм

Какое же общее между развивающимся эмбрионом, муравьиной колонией и новейшей версией ChatGPT? На...

Как «Евразия» меняет повседневную жизнь миллионов в Кыргызстане

Две страны - не просто соседи, они связаны тысячами живых нитей Россия и Кыргызстан представляют...

«Война изменится до неузнаваемости». Полковник Генштаба России — об уроках военных действий в Украине, переменах в армии и оружии будущего

Конфликт в Украине стал не просто катализатором изменений в военной сфере, но и кардинально...

Сестра Чингиза Айтматова обратилась к кыргызстанцам (текст обращения)

В своём обращении Роза Торокуловна затрагивает тему недобрых слухов и обвинений, которые активно...

Нужны ли клинические базы, чтобы научить хорошего врача? Пояснение профессора Т.Батыралиева

В Кыргызской Республике реформа системы подготовки медицинских кадров становится одной из ключевых...

Как большие данные меняют прогнозы. Аналитика, алгоритмы и тренды 2026 года

Трансформация прогнозирования с помощью больших данных в 2026 годуСпортивные прогнозы в 2026 году...

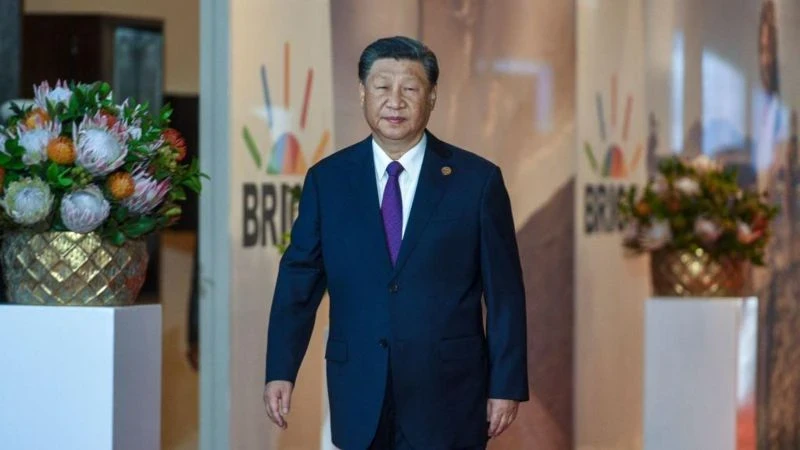

Си Цзиньпин проводит чистки в генералитете. Что это означает для Китая и его соседей, в том числе Центральной Азии?

На выходных в Китае произошла отставка генерала Чжан Юся, который занимал пост заместителя...

Почему Трамп пригласил в "Совет мира" из ЦА только Казахстан и Узбекистан? Мнения

16 января президент США Дональд Трамп объявил о создании новой международной структуры под...

Зеленский рассказал о 20 пунктах мирного плана. Что в нем нового?

Президент Украины Владимир Зеленский представил проект соглашения об окончании войны, над которым...

Город против собак. Отстрел животных, что это: коррупция, антигуманность или решение проблем?

Как в Бишкеке решается вопрос с уличными животными События, связанные с бездомными животными, в...

Голосовать — право или обязанность? Спорный законопроект депутата

Депутат Марлен Маматалиев выступил с инициативой сделать участие граждан Кыргызстана в выборах и...

Арсен Аскеров: подготовку врачей в акушерстве, гинекологии и педиатрии необходимо кардинально усиливать

Доктор медицинских наук и президент Кыргызской ассоциации акушеров-гинекологов и неонатологов Арсен...

Токаев дал большое интервью газете Turkistan. Там про реформы, ИИ, АЭС, Назарбаеве и многом другом

Президент Касым-Жомарт Токаев в своем интервью для Turkistan поделился мнением о текущих вызовах и...

Ректор Кудайберди Кожобеков: ОшГУ - флагман высшего образования Кыргызстана

В этом интервью с ректором Ошского государственного университета Кудайберди Кожобековым мы...

ChatGPT будет определять возраст пользователей

Компания OpenAI анонсировала новое обновление для ChatGPT, которое позволит определять возраст...

OpenAI запускает рекламу в бесплатной версии ChatGPT

Компания OpenAI сообщила о начале тестирования рекламы в своем продукте ChatGPT. Объявления будут...

TikTok отслеживает вас, даже если вы не используете приложение

Как оказалось, TikTok собирает конфиденциальные и даже компрометирующие данные о пользователях,...

Монгольский инженер в Audi, дизайнер перспективных концептуальных автомобилей Audi Activesphere и Audi Concept C

ДАВААДОРЖ Баттөгс По информации, предоставленной MiddleAsanNews, Даваадорж Баттөгс является...

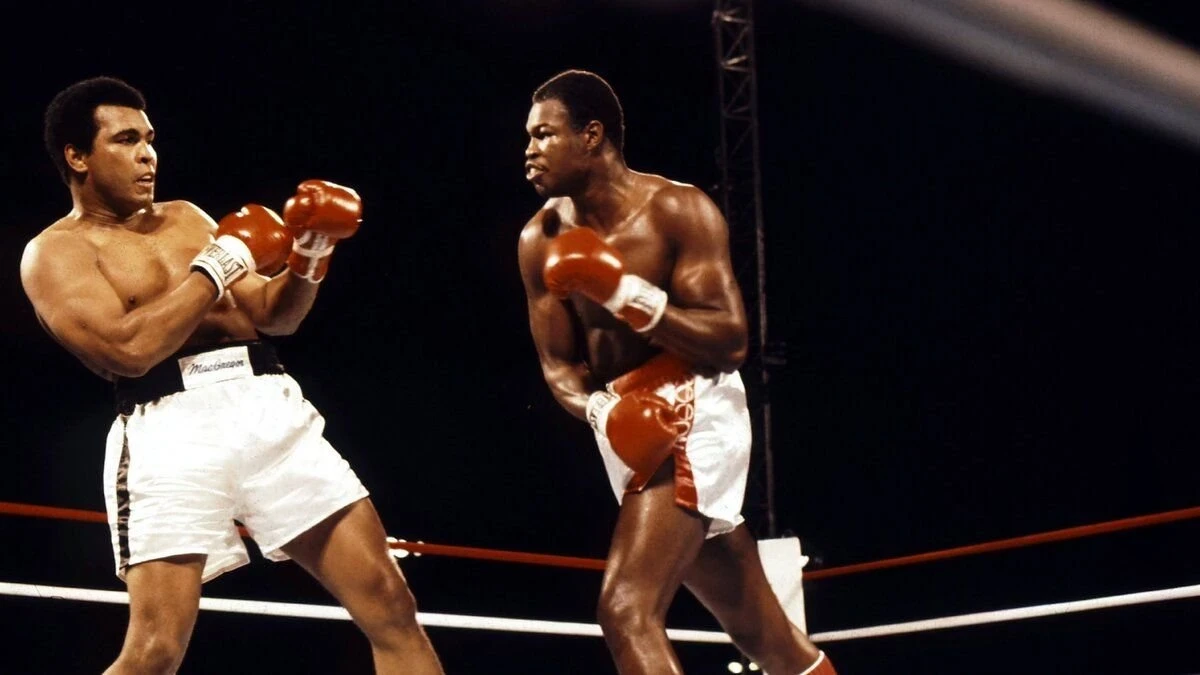

Исследование в лаборатории: миф о том, что бокс стал причиной болезни Паркинсона у Мухаммеда Али

Вопрос о том, стал ли бокс причиной болезни Паркинсона у Мухаммеда Али, вызывает горячие споры. В...

"Муж так и не смог принять, что наша дочь больна". История матери-одиночки и ее дочери

Бегимай Токтосунова, будучи матерью-одиночкой, столкнулась с огромными трудностями после развода,...

Наши за рубежом: Кыргызстанка Жыпара Камалидин кызы в Корее перепутала «гичим» с «кимчи» и вместо 10 000 вон дала «10 сом»

Turmush продолжает знакомить читателей с кыргызстанцами, которые нашли новое место жительства за...

Садыр Жапаров выступил на IV Народном Курултае (текст выступления)

Сегодня, 25 декабря, президент Кыргызстана Садыр Жапаров обратился к народу, депутатам Жогорку...

Аскат Алагозов: Садыр Жапаров не раздает деньги в соцсетях

Граждан призывают быть внимательными Аскат Алагозов, пресс-секретарь президента, сообщил о...